Abstract

卷积神经网络(CNN)的中心组成部分是卷积运算子,它使网络能够通过在每个层的局部感受野中融合空间和通道信息来构建信息特征。

之前的一项广泛研究调查了这种关系的空间组件,试图通过提高整个特征层次结构中空间编码的质量来加强CNN的表示能力。

在这项工作中,作者专注于通道关系,并提出了一个新的架构单元,称之为“Squeeze-and-Excitation”(SE)块,通过显式建模通道之间的相互依存关系,自适应地重新校准通道特征响应。

作者表明,这些块可以堆叠在一起,形成SENet架构,在不同的数据集中非常有效地泛化。

我们进一步证明,SE块以略微的额外计算成本显著提高了现有最先进的CNN的性能。

Squeeze-and-Excitation 网络构成了我们提交ILSVRC 2017分类的基础,该分类获得了第一名,并将 top-5 的错误减少到2.251%,以约25%的相对改进超过了2016年的获胜者。

Ablation Study

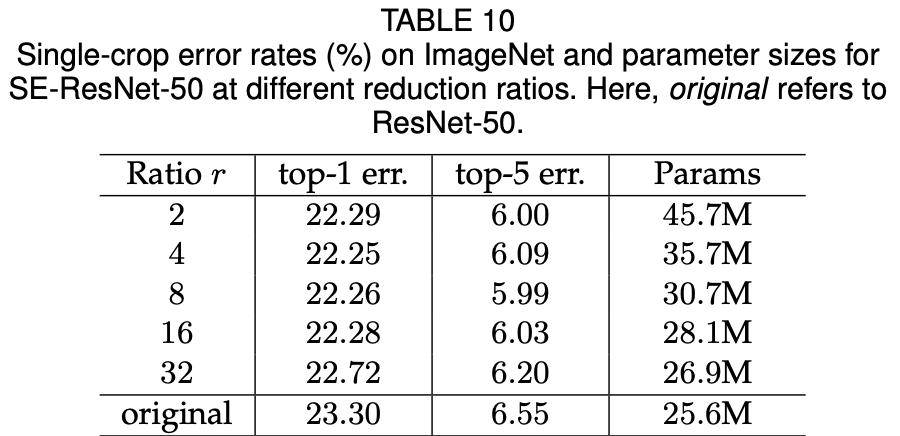

Reduction ratio

Eqn.5中引入的 reduction ratio $r$ 是一个超参数,它允许改变网络中SE块的容量和计算成本。为了研究由该超参数的性能和计算成本之间的权衡,作者对一系列不同的 $r$ 值进行了SE-ResNet-50的实验。表10中的比较表明,性能对一系列 reduction ratio 是稳健的。复杂度的增加不会单调地提高性能,而较小的比率会显著增加模型的参数大小。设置 $r = 16$ 在准确性和复杂性之间实现了良好的平衡。在实践中,在整个网络中使用相同的比率可能不是最佳的(由于不同层发挥着不同的角色),因此可以通过调整比率来满足给定基础架构的需求来实现进一步的改进。

Conclusion

本文提出了SE块,这是一个架构单元,旨在通过使网络能够执行动态信道特征重新校准来提高网络的表示能力。

广泛的实验显示了SENets的有效性,SENets在多个数据集和任务中实现了最先进的性能。

此外,SE块揭示了以前的架构无法充分建模通道特征依赖。

作者希望这种洞察力可能对需要强烈判别特征的其他任务有用。

最后,SE块产生的特征重要性值可能可用于其他任务,例如用于模型压缩的网络修剪。

-

Previous

【深度学习】DeSCI:Rank Minimization for Snapshot Compressive Imaging -

Next

【深度学习】DeepLab V3:Rethinking Atrous Convolution for Semantic Image Segmentation