On this page

Abstract

引导式图像合成使日常用户能够以最小的努力创建和编辑逼真的照片图像。

关键的挑战是平衡对用户输入(例如手绘彩色笔画)的忠实性和合成图像的真实性。

现有的基于GAN的方法试图使用条件GAN或GAN反转来实现这种平衡,这些反转具有挑战性,通常需要额外的训练数据或单个应用的损失函数。

为了解决这些问题,我们引入了一种新的图像合成和编辑方法,随机微分编辑(SDEdit),基于扩散模型生成先验,该方法通过随机微分方程(SDE)迭代去噪来合成逼真图像。

给定以 操作RGB像素的形式 带有用户指南的输入图像,SDEdit 首先为输入添加噪声,然后通过 SDE 对生成的图像进行去噪,然后再提高其真实性。

SDEdit不需要特定任务的训练或反转,自然可以在保真度和忠实度之间实现平衡。

根据一项人类感知研究,在多项任务(包括基于笔画的图像合成和编辑以及图像合成)上,SDEdit在保真度方面比最先进的GAN方法优于98.09%,总体满意度得分为91.72%。

Introduction

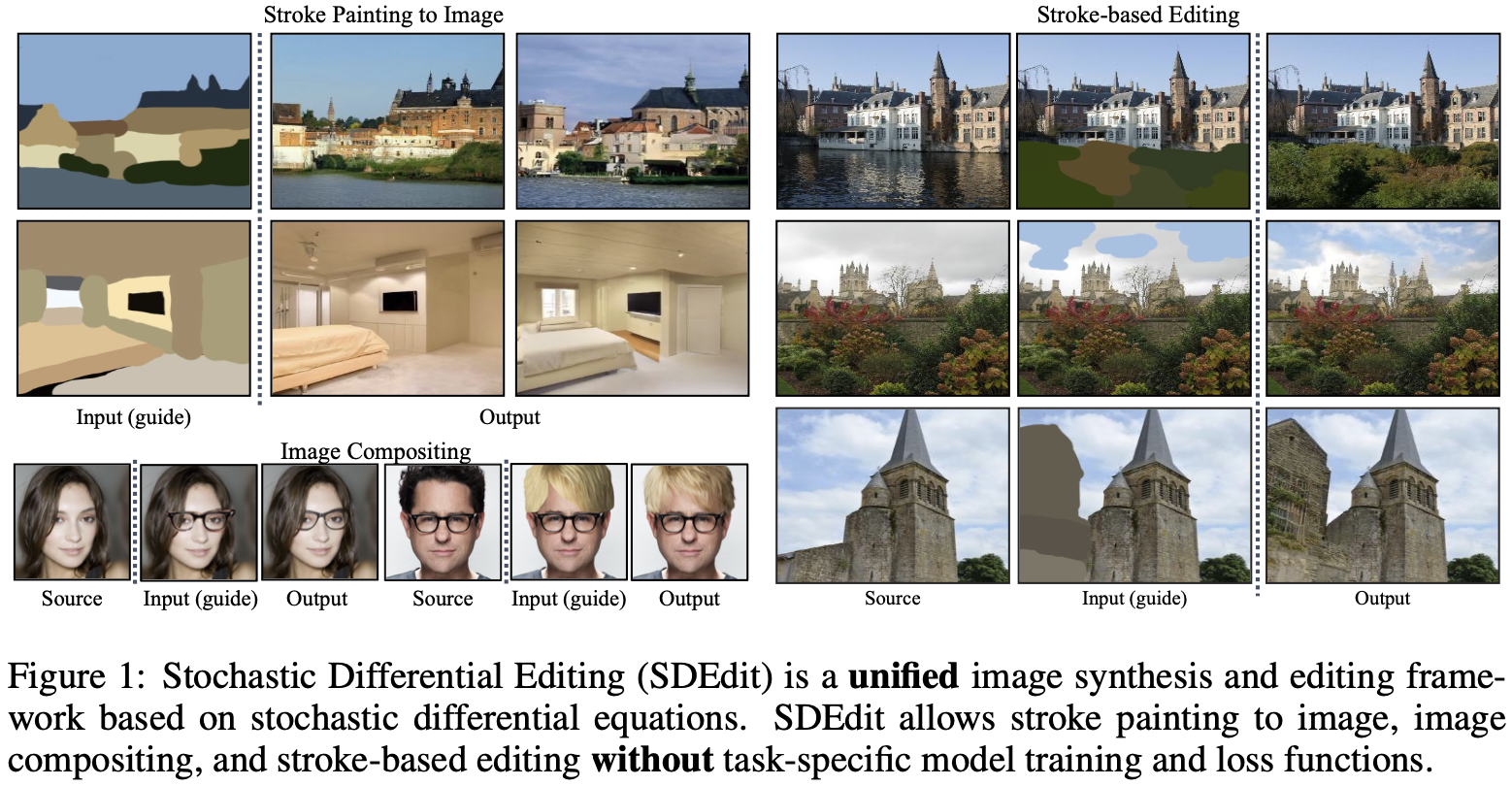

现代生成模型可以从随机噪声中创建逼真的照片图像(Karras等人,2019年;Song等人,2021年),作为视觉内容创建的重要工具。特别有趣的是引导图像合成和编辑,用户指定引导(如粗彩色笔画),生成模型学习填充细节(见图1)。

引导图像合成有两个目标:合成图像应该看起来逼真,并忠实于用户引导的输入,从而使具有或没有艺术专业知识的人能够从不同层次的细节制作逼真的照片图像。

与条件GAN不同,SDEdit不需要为每个新任务收集训练图像或用户注释;与GAN反转不同,SDEdit不需要设计额外的训练或特定任务的损失函数。SDEdit 仅使用在未标记数据上训练的单个预训练的基于SDE的生成模型:给定以操作RGB像素形式的引导,SDEdit将高斯噪声添加到引导中,然后运行反向SDE来合成图像。SDEdit 自然会在保真度和忠实度之间找到权衡:当我们添加更多的高斯噪声并运行更长时间的SDE时,合成图像更逼真,但更不忠实。我们可以利用这种观察在保真度和忠诚度之间找到正确的平衡。

我们在三个应用上演示了SDEdit:基于笔画的图像合成、基于笔画的图像编辑和图像合成。我们表明,SDEdit可以从不同保真度级别的引导中生成逼真和忠实的图像。根据人类判断,在基于笔画的图像合成实验中,SDEdit在保真度评分上比基于GAN的方法高出98.09%,在总体满意度(衡量保真度和忠实度)方面比最先进的方法优于91.72%。在图像合成实验中,SDEdit实现了更好的保真度分数,在用户研究中的总体满意度得分超过基线83.73%。我们的代码和模型将在发布时提供。